Secondo un’analisi di NewsGuard, le pubblicità programmatiche di decine di grandi marchi, governi, istituzioni educative e organizzazioni non profit su X vengono visualizzate nei feed subito sotto a post virali contenenti affermazioni false o palesemente fuorvianti sulla guerra tra Israele e Hamas. Secondo le condizioni previste da un nuovo programma di condivisione delle entrate pubblicitarie introdotto da X per i suoi “creator”, pare che una parte delle entrate pubblicitarie generate da queste organizzazioni verrebbe condivisa con questi super-diffusori di misinformazione.

Dal 13 al 22 novembre 2023, gli analisti di NewsGuard hanno esaminato gli annunci programmatici apparsi nei feed sottostanti a 30 post virali che contenevano informazioni false o palesemente fuorvianti sulla guerra. Gli annunci programmatici sono posizionati tramite algoritmi perché siano visualizzati dai lettori online. In genere, i marchi non scelgono – e di fatto non sanno – dove gli annunci appaiono.

I 30 post virali sono stati pubblicati da dieci dei maggiori diffusori di misinformazione sulla guerra tra Israele e Hamas. Questi account, infatti, sono stati precedentemente identificati da NewsGuard come diffusori seriali di misinformazione sul conflitto. Secondo i dati di X, questi 30 post hanno raggiunto cumulativamente un pubblico di oltre 92 milioni di utenti. In media, ogni post è stato visto da 3 milioni di persone.

Un elenco dei 30 post e dei 10 account utilizzati nell’analisi di NewsGuard è disponibile qui.

I 30 post hanno avanzato alcune delle affermazioni false o fuorvianti più eclatanti sulla guerra, che NewsGuard aveva precedentemente verificato e smentito nel suo database Misinformation Fingerprints, un catalogo delle affermazioni false più significative diffuse online. Tra queste, l’affermazione secondo cui l’attacco di Hamas contro Israele del 7 ottobre 2023 sarebbe stato una “false flag” e quella secondo cui la CNN avrebbe realizzato un falso servizio nell’ottobre 2023 su un attacco missilistico contro una sua troupe giornalistica in Israele. Metà dei post (15) includevano una Nota della comunità, la funzione di fact-checking in crowdsourcing di X. In base alla policy della piattaforma, gli utenti i cui post contengono una Nota della comunità non hanno i requisiti per ricevere entrate pubblicitarie. Tuttavia, l’altra metà dei post individuati non conteneva Note della comunità. NewsGuard ha trovato annunci di marchi importanti come Pizza Hut, Airbnb, Microsoft, Paramount e Oracle su post con e senza Note della comunità (si veda di seguito).

In totale, gli analisti di NewsGuard hanno identificato 200 annunci di 86 grandi marchi, organizzazioni non profit, istituzioni educative e governi apparsi nei feed subito sotto a 24 dei 30 post contenenti affermazioni false o palesemente fuorvianti sulla guerra tra Israele e Hamas. Gli altri sei post non contenevano pubblicità. (Su X, gli annunci pubblicitari appaiono come post che vengono mostrati agli utenti nei feed). Gli annunci che NewsGuard ha trovato sono stati visualizzati da analisti che utilizzavano i propri account X in cinque Paesi: Stati Uniti, Regno Unito, Germania, Francia e Italia.

Questa analisi di NewsGuard giunge dopo la decisione di Apple, Disney e IBM di rimuovere i loro annunci da X quando il proprietario Elon Musk ha commentato positivamente un post antisemita sulla piattaforma. In risposta alle domande inviate via email da NewsGuard sui risultati di questo report e sugli annunci che appaiono nei feed sotto i post che promuovono misinformazione, l’ufficio stampa di X ha inviato una risposta automatica: “Ora siamo occupati, si prega di riprovare più tardi”.

Il 21 novembre, dopo che NewsGuard ha contattato X in merito a questo report, Musk ha twittato: “X Corp donerà tutte le entrate derivanti dalla pubblicità e dagli abbonamenti associati alla guerra a Gaza agli ospedali in Israele e alla Croce Rossa/Crescent a Gaza”. Non è chiaro cosa Musk intendesse con “ricavi da pubblicità e abbonamenti associati alla guerra a Gaza”. In risposta alla richiesta di NewsGuard del 22 novembre, che chiedeva chiarimenti sull’annuncio di Musk, l’ufficio stampa di X ha risposto nuovamente con un messaggio automatico.

Oracle, Pizza Hut e Anker: monetizzare la misinformazione su un “cadavere di bambino bruciato”

Il 29 ottobre 2023, Elon Musk, proprietario di X, ha dichiarato che gli utenti i cui post vengono corredati di Note della comunità non avrebbero più potuto guadagnare con gli annunci pubblicitari su quel particolare post. Ciononostante, NewsGuard ha trovato annunci pubblicitari di 70 grandi organizzazioni su 14 dei 15 post che diffondevano misinformazione sulla guerra e che non presentavano Note della comunità. Ciò significa che alcuni dei peggiori diffusori di misinformazione sulla guerra di X hanno probabilmente potuto ricevere entrate pubblicitarie da grandi organizzazioni.

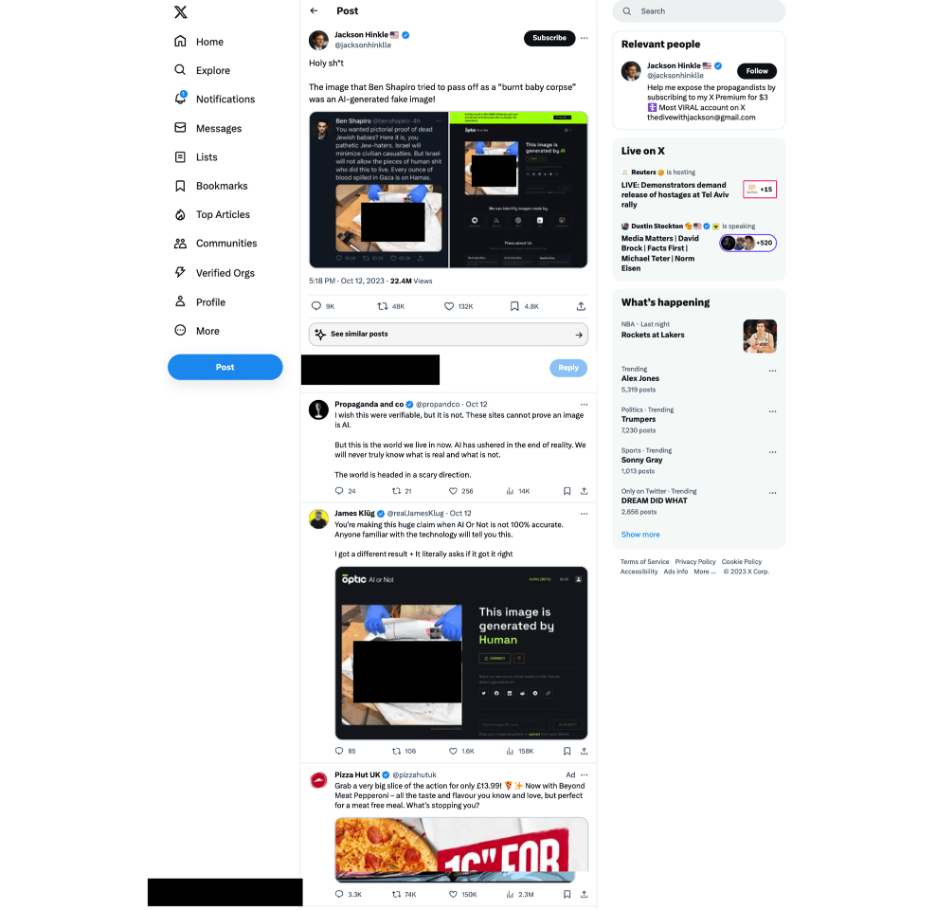

Ad esempio, NewsGuard ha trovato 22 pubblicità di importanti organizzazioni su tre post di Jackson Hinkle che contenevano informazioni false sulla guerra e che non riportavano alcuna Nota della comunità. Hinkle è un opinionista che si definisce un “conservatore americano marxista-leninista” e che ha diffuso decine di affermazioni false e fuorvianti sulla guerra, secondo quanto riscontrato da NewsGuard.

Annunci di Oracle, Pizza Hut e Anker, tra gli altri, sono apparsi agli analisti di NewsGuard sotto a un post di Hinkle il 12 ottobre 2023, che conteneva l’affermazione falsa secondo cui il conduttore del podcast Daily Wire Ben Shapiro avrebbe usato l’intelligenza artificiale per generare l’immagine di un bambino ucciso da Hamas. Il post di Hinkle ha ricevuto 22 milioni di visualizzazioni al 20 novembre. Anche in questo caso, proprio a causa di come funziona la pubblicità programmatica, i brand non hanno il controllo di dove appaiono i loro annunci e, di conseguenza, di chi vanno a finanziare attraverso la pubblicità.

“Porca pu***na”, ha scritto Hinkle. “L’immagine che Ben Shapiro ha cercato di far passare per un ‘cadavere di bambino bruciato’ era un’immagine falsa generata dall’IA!”. In realtà, non ci sono prove che la foto, che è stata condivisa per la prima volta dal governo israeliano, sia stata generata utilizzando l’IA. Hany Farid, professore presso la Scuola di Informazione dell’Università di Berkeley, ha dichiarato al sito di notizie sulla tecnologia 404 Media che l’immagine del bambino “non mostra alcun segno di essere stata creata dall’IA”. La consistenza strutturale, l’accuratezza delle ombre, la mancanza di artefatti che tendiamo a vedere nei contenuti creati da IA mi porta a credere che non sia nemmeno parzialmente generata dall’intelligenza artificiale”. Al 20 novembre, il post di X non includeva alcuna Nota della comunità, il che significa che Hinkle era probabilmente idoneo a ricevere parte dei proventi degli annunci.

Allo stesso modo, NewsGuard ha trovato annunci di 36 importanti inserzionisti (alcune organizzazioni sono apparse più di una volta) su tre post dell’opinionista di estrema destra @ShadowofEzra che diffondevano misinformazione sulla guerra. Nessuno dei tre post conteneva una Nota della comunità.

In prossimità di uno di questi post, che sosteneva che l’attacco del 7 ottobre 2023 contro Israele da parte di Hamas sia stato una “false flag” (affermazione infondata), agli analisti di NewsGuard sono stati mostrati annunci di Paramount, Microsoft, della società di robotica ABB Robotics, della banca d’investimento italiana Mediobanca e della società di materie prime Sappi Group. “Ecco la conferma che gli eventi che si stanno verificando in Israele sono una false flag”, si legge nel post di @ShadowofEzra. “Quanto si può essere stupidi per credere che Hamas abbia la capacità di invadere Israele via terra, aria e mare?… O hanno lasciato che accadesse o l’hanno fatto accadere”. Al 21 novembre 2023, il post era stato visualizzato 1,1 milioni di volte. (Il 17 novembre, la Paramount ha dichiarato di aver interrotto le pubblicità su X. La pubblicità della Paramount è stata visualizzata da un analista prima di tale annuncio).

Allo stesso modo, annunci di Airbnb, Virgin Group, Asus, azienda tecnologica taiwanese, The Dispatch, società di media di orientamento conservatore, e Essity, azienda svedese multimiliardaria del settore igiene, accompagnavano un post dell’opinionista conservatore Matt Wallace che definiva, senza alcun fondamento, l’attacco di Hamas contro Israele un “inside job”. Il post non conteneva Note della comunità e al 21 novembre aveva ricevuto 1,2 milioni di visualizzazioni.

Va specificato che per poter beneficiare della condivisione dei ricavi pubblicitari di X, i titolari degli account devono soddisfare tre criteri specifici: essere abbonati a X Premium (per 8 dollari al mese), aver raccolto almeno cinque milioni di impression organiche sui propri post negli ultimi tre mesi e avere un minimo di 500 follower. Tutti i 10 account super-diffusori analizzati da NewsGuard sembrano soddisfare questi criteri.

Così governi e organizzazioni non profit finanziano indirettamente la macchina della misinformazione sulla guerra tra Israele e Hamas

Delle 200 pubblicità individuate da NewsGuard sui post dei super-diffusori che contenevano misinformazione legata alla guerra, 26 erano di organizzazioni affiliate a governi, tra cui agenzie governative, imprese e media gestiti o controllati da governi.

Ad esempio, NewsGuard ha trovato un annuncio pubblicitario dell’FBI su un post di Jackson Hinkle del 9 novembre 2023, che faceva riferimento a un presunto video che mostrerebbe un elicottero militare israeliano sparare sui propri cittadini. Il post non contiene alcuna Nota della comunità e al 20 novembre era stato visualizzato più di 1,7 milioni di volte.

“ISRAELE AMMETTE di aver sparato sui propri civili con elicotteri d’attacco APACHE!”, ha scritto Hinkle nel post che rimanda al video. In realtà, il video mostra degli aerei dell’aviazione israeliana che effettuano alcuni attacchi contro Hamas nella Striscia di Gaza, secondo GeoConfirmed, un gruppo investigativo open-source.

Lo spot dell’FBI apparso sotto il post di Hinkle promuoveva il lavoro dell’agenzia per fermare i crimini d’odio. “I crimini d’odio non solo danneggiano le vittime, ma incutono anche paura alle loro comunità”, si leggeva nell’annuncio. “L’FBI è impegnata a combattere i crimini d’odio e a cercare giustizia per le vittime”. Il 20 novembre, NewsGuard ha inviato all’FBI due email e un messaggio tramite il modulo di contatto disponibile sul suo sito, per chiedere se l’annuncio fosse stato inserito di proposito. Un portavoce dell’FBI non ha fornito alcun commento sulla questione e ha consigliato a NewsGuard di fare riferimento a X per avere informazioni sull’inserimento di annunci sulla piattaforma.

Tra gli altri annunci di enti governativi individuati vi era una pubblicità della compagnia statale Abu Dhabi National Oil sotto un post che sosteneva di mostrare – senza fornire alcuna prova – un blogger palestinese che fingeva di aver riportato ferite durante la guerra; un annuncio del Ministero della Cultura di Taiwan sotto un post che riportava la notizia falsa relativa al presunto video che proverebbe come Israele abbia sparato contro i suoi stessi civili; e un annuncio della China Global Television Network (CGTN) – un’emittente di proprietà del governo cinese – sotto un post di Matt Wallace secondo cui l’11 settembre sarebbe stato un “attacco sotto ‘falsa bandiera’ del governo israeliano”. Al 21 novembre, nessuno di questi post presentava Note della comunità.

NewsGuard ha inoltre trovato annunci di alcune organizzazioni non profit e istituzioni educative in prossimità di post contenenti misinformazione sulla guerra. Ad esempio, NewsGuard ha visualizzato un annuncio di Clean Air Action Fund, un’organizzazione non profit dedicata alla riduzione dell’inquinamento atmosferico, su un post di @YosephHaddad che riportava la notizia falsa secondo cui un video della CNN mostrerebbe un ‘attore’ palestinese. Il post, che non riportava alcuna Nota della comunità, è stato visualizzato più di 639.000 volte al 21 novembre. (NewsGuard ha visualizzato anche un annuncio del Danish National Genome Center, un’agenzia del Ministero della Salute danese, sullo stesso post).

Sul già citato post di Hinkle a proposito del presunto video che mostrerebbe Israele sparare sui propri cittadini, è apparso anche un annuncio dell’Università di Baltimora, nel Maryland.

Un post di @ShadowofEzra, in cui si affermava che la guerra in corso sarebbe in realtà un’operazione sotto falsa bandiera, o “false flag”, era accompagnato da un annuncio della Royal Society of Chemistry, una società accademica britannica senza scopo di lucro il cui obiettivo è quello di “far progredire le scienze chimiche”. Nel post, @ShadowofEzra rimandava a un’intervista della CNN in cui il portavoce del Consiglio di Sicurezza nazionale degli Stati Uniti John Kirby si commuove mentre parla dell’attacco di Hamas contro Israele del 7 ottobre 2023. “John Kirby si mette a piangere in diretta sulla CNN”, ha scritto @ShadowofEzra. “Serve un’altra prova del fatto che si sia trattato di una false flag?”.

Metodologia

Tra il 13 e il 22 novembre 2023, NewsGuard ha analizzato 30 post contenenti misinformazione sulla guerra pubblicati da 10 account precedentemente identificati come super-diffusori di misinformazione sul conflitto tra Israele e Hamas. NewsGuard considera “super-diffusori di misinformazione” account che hanno diffuso tre o più affermazioni false o palesemente fuorvianti sulla guerra e hanno più di 100.000 follower su X. Molti degli account considerati hanno diffuso ben più di tre affermazioni false o palesemente fuorvianti sull’argomento.

Per simulare l’esperienza di visualizzazione di annunci pubblicitari programmatici di diversi utenti, NewsGuard ha utilizzato delle reti private virtuali (VPN) – uno strumento che consente di navigare in Internet come se ci si trovasse in un altro Paese – e ha aggiornato ripetutamente la pagina di ciascuno dei 30 post. Per ogni post, NewsGuard ha navigato dagli Stati Uniti, dal Regno Unito, dalla Germania, dalla Francia e dall’Italia e ha aggiornato la pagina per un massimo di 25 volte. NewsGuard ha scrollato il feed per farlo “ricaricare” fino a un massimo di cinque volte, perché non tutte le risposte a un determinato post vengono mostrate nella schermata iniziale.

Nell’esaminare i 10 account, gli analisti hanno cercato le pubblicità presenti nella sezione “risposte” dei post contenenti misinformazione sulla guerra. Le risposte – e le pubblicità in esse contenute – vengono mostrate subito sotto i post. Gli analisti hanno poi raccolto gli screenshot di ogni pubblicità apparsa.

X ha recentemente citato in giudizio Media Matters for America per un articolo pubblicato dal gruppo di advocacy progressista che riguardava delle pubblicità di marchi importanti apparse accanto ad account con contenuti estremisti. In questo caso, X ha sostenuto che Media Matters abbia ‘abbinato’ questi marchi a questo genere di contenuti utilizzando account X che seguivano soltanto un gruppo selezionato di brand importanti e un gruppo ristretto di account con contenuti estremisti. Secondo la causa intentata da X, ciò avrebbe generato uno scenario “inorganico” in cui gli annunci di questi marchi sarebbero apparsi accanto a questi contenuti, producendo così “immagini affiancate confezionate intenzionalmente”.

Senza speculare sulla veridicità di queste affermazioni, facciamo notare che la metodologia di NewsGuard è diversa da quella che, secondo X, sarebbe stata utilizzata da Media Matters for America:

- NewsGuard non ha manipolato il campione seguendo selettivamente alcuni marchi o account. Al contrario, i suoi analisti hanno esaminato i contenuti virali che sono apparsi naturalmente sulla piattaforma e che venivano mostrati sui loro account personali di X.

- I post analizzati da Media Matters for America hanno ricevuto relativamente poche visualizzazioni. Come già detto, i 30 post analizzati da NewsGuard hanno raggiunto cumulativamente un’audience di oltre 92 milioni di utenti, secondo i dati di X. In media, ogni post è stato visto da 3 milioni di persone.

- NewsGuard ha limitato il numero di volte in cui ha aggiornato ogni post in ogni Paese preso in considerazione (25) e il numero di volte in cui ha ‘scrollato’ il feed per farlo scorrere (cinque). (In un determinato feed, X mostra solo un numero limitato di risposte a un post specifico).

A cura di Jack Brewster, Coalter Palmer e Nikita Vashisth

Con il contributo di Natalie Adams, John Gregory, Sam Howard, McKenzie Sadeghi e Roberta Schmid