Secondo un’analisi di NewsGuard, quasi tre quarti dei post più popolari su X che promuovono misinformazione sulla guerra tra Israele e Hamas sono stati pubblicati da account “verificati”.

Nel marzo 2023, il proprietario di X Elon Musk ha modificato il sistema di verifica della piattaforma, consentendo agli utenti di pagare 8 dollari al mese per ottenere la spunta blu sul proprio profilo e per far sì che ai loro post venga accordata priorità di visualizzazione da parte dell’algoritmo di X (precedentemente noto come Twitter). In questo modo, i post vengono visualizzati più in alto e con maggiore evidenza nei feed degli utenti. Questa decisione si è rivelata una vera e propria manna dal cielo per gli attori malintenzionati che condividono misinformazione sulla guerra tra Israele e Hamas. Al costo di un biglietto del cinema ora possono accedere a un pubblico più vasto e assicurarsi la credibilità associata al prestigioso segno di spunta blu.

Durante la prima settimana del conflitto (dal 7 al 14 ottobre), NewsGuard ha analizzato i 250 post in lingua inglese con maggiore engagement (cioè quelli che hanno ricevuto più like, repost, risposte e segnalibri) che promuovevano una delle 10 principali narrazioni false o infondate relative alla guerra e incluse nel catalogo dei Misinformation Fingerprints, il database di NewsGuard sulle principali narrazioni false che si diffondono online. 186 di questi 250 post – il 74% – sono stati condivisi da account X verificati.

Di seguito, le 10 affermazioni false o non comprovate identificate da NewsGuard e condivise da questi account:

- L’Ucraina ha venduto armi a Hamas

- Israele ha ucciso 33.000 bambini palestinesi dal 2008

- Un video mostra alcuni bambini israeliani tenuti in ostaggio in gabbie da Hamas

- Un video mostra alcuni alti funzionari israeliani catturati da Hamas nell’ottobre 2023

- La chiesa ortodossa di San Porfirio a Gaza è stata distrutta dai bombardamenti israeliani

- Un video mostra alcuni combattenti di Hamas che festeggiano il rapimento di una bambina israeliana

- La CNN ha simulato un attacco missilistico in Israele nell’ottobre 2023

- Un documento della Casa Bianca dimostra che gli Stati Uniti stanno inviando 8 miliardi di dollari in aiuti militari a Israele

- In un video, Israele ha inscenato la morte di un bambino da parte di Hamas

- L’attacco terroristico di Hamas è in realtà una ‘false flag’ orchestrata da Israele o dall’Occidente.

Complessivamente, i post che diffondono queste narrazioni false hanno ricevuto 1.349.979 interazioni (repost, like, segnalibri e risposte) e sono stati visti in totale più di cento milioni di volte in una sola settimana.

A fronte delle critiche sul fatto che i cambiamenti apportati alle policy della piattaforma abbiano portato a un aumento della misinformazione, Musk ha spesso rivendicato il rafforzamento della funzione di fact-checking in crowdsourcing di X, le cosiddette “Note della comunità”. Tuttavia, NewsGuard ha rilevato che solo 79 dei 250 post contenenti misinformazione sulla guerra erano stati segnalati dalla piattaforma con una Nota della comunità. Ciò significa che solo nel 32% dei casi circa sono apparse note di fact-checking su alcuni dei post di misinformazione più popolari e pericolosi apparsi sulla piattaforma (maggiori informazioni in seguito).

È importante sottolineare che NewsGuard ha trovato narrazioni false o non comprovate sulla guerra anche su altre piattaforme, come Facebook, Instagram, TikTok e Telegram. Tuttavia, si è scelto di concentrarsi su X perché quest’ultima sembra essere l’unica piattaforma che ha reso pubblica la decisione di ridurre i suoi sforzi di moderazione dei contenuti. NewsGuard ha anche scoperto che, nei primi giorni della guerra, la maggior parte delle narrazioni false relative al conflitto tra Israele e Hamas sembrano essere divenute virali su X, prima di diffondersi su altre piattaforme come TikTok e Instagram. In risposta alle domande inviate via email in merito ai risultati di questo report e alle pratiche di controllo messe in atto dalla piattaforma sugli account di X Premium, l’ufficio stampa di X ha inviato una risposta automatica: “Ora siamo occupati, per favore ricontrollate più tardi”.

Come funziona X Premium

Prima dell’acquisizione di X (l’allora Twitter) da parte di Musk, gli utenti venivano verificati sulla base di criteri quali l’“autenticità, la notorietà e l’attività”, nell’ambito di quella che oggi la piattaforma definisce verifica “Legacy”.

Ora, un utente non deve necessariamente essere “noto” per ricevere una spunta blu di verifica. Per essere verificato su X, si deve semplicemente pagare 8 dollari, verificare il proprio numero di telefono e aggiungere una foto profilo (X non specifica se la foto debba essere del proprietario del profilo o, in generale, di una persona reale). L’account deve anche accettare di non “appropriarsi indebitamente dell’identità di individui, gruppi o organizzazioni” e di non fare “spam”, secondo quanto riportato nel Centro assistenza di X. La piattaforma spiega poi che un badge blu apparirà sul profilo dell’utente verificato una volta che il suo team avrà “esaminato l’account Premium sottoscritto dall’utente e controllato se soddisfa i requisiti [della piattaforma]”.

X non rivela alcuna informazione su come, o se, esamini le richieste per l’ottenimento della spunta blu. Inoltre, X non richiede che venga pubblicato sull’account un nome vero.

Come accennato in precedenza, oltre a un’aura di presunta credibilità, agli account verificati viene anche garantita priorità di visualizzazione dall’algoritmo della piattaforma. Sebbene non sia chiaro in che modo X modifichi la posizione dei post nei feed degli utenti, l’analisi di NewsGuard suggerisce che questa dinamica risulta significativa, se non determinante, perché un post diventi virale.

In effetti, gli account Premium di X sono stati cruciali nella diffusione delle bufale più popolari sulla guerra identificate da NewsGuard. Dei 25 post a più alto engagement che promuovevano la bufala più condivisa in lingua inglese tra quelle individuate da NewsGuard – e cioè quella secondo cui l’Ucraina avrebbe venduto armi ad Hamas –, 24 dei 25 post provenivano da account Premium. 23 dei 25 post che hanno promosso la seconda bufala più condivisa in lingua inglese – secondo cui la CNN avrebbe simulato un attacco in diretta in cui sarebbe stata coinvolta una sua troupe – sono stati postati da account accompagnati dalla spunta blu.

I superdiffusori di misinformazione sulla guerra tra Israele e Hamas con la spunta blu

NewsGuard ha identificato sette account che hanno diffuso almeno due delle narrazioni false più condivise sulla guerra. Tutti sono stati verificati da X con la spunta blu.

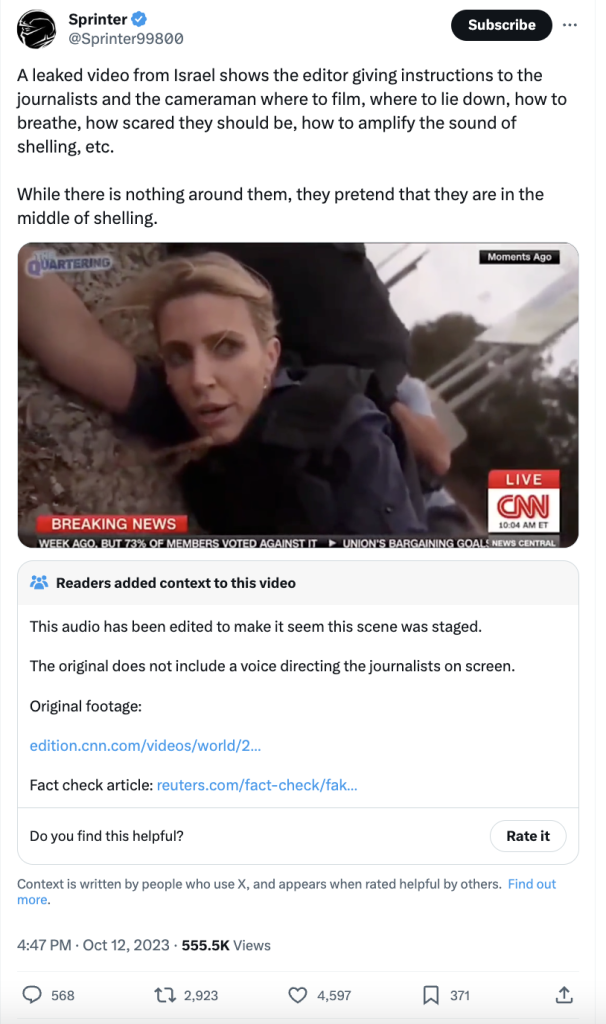

Ad esempio, l’utente verificato @Sprinter99800, un account anonimo con più di 361.000 follower, ha condiviso cinque diverse bufale sulla guerra, tra cui l’affermazione secondo cui un video, in realtà fuori contesto, mostrerebbe degli alti funzionari israeliani catturati da Hamas e la narrazione secondo la quale la CNN avrebbe inscenato un finto servizio su un attacco missilistico in cui sarebbe stata coinvolta una delle sue troupe giornalistiche. L’account era stato bandito da X nel 2022 per motivi non noti, secondo il sito di fact-checking gestito da Voice of America, Polygraph.Info, ed era stato poi reintegrato dopo l’acquisizione di X da parte di Musk. Ha ottenuto la spunta blu nel settembre 2023, un mese prima dell’inizio della guerra tra Israele e Hamas.

Nel complesso, i post di @Sprinter99800 sono stati visualizzati quasi tre milioni di volte.

“Un video trapelato da Israele mostra il redattore [della CNN] che dà istruzioni ai giornalisti e al cameraman su dove filmare, dove sdraiarsi, come respirare, quanta paura devono avere, come amplificare il suono dei bombardamenti, ecc”, ha scritto @Sprinter99800, rimandando a un video che, in apparenza, dimostrerebbe come la CNN abbia messo in scena un attacco con un razzo in Israele. “Non c’è nulla intorno a loro, ma fanno finta di essere nel mezzo di un bombardamento”. (In realtà, al video è stata aggiunta una voce fuori campo per far sembrare che la troupe stesse seguendo delle istruzioni).

Il post, che conteneva una Nota della comunità in cui si affermava (correttamente) che l’audio del video allegato era stato manipolato, ha ottenuto più di 8.100 interazioni e 550.000 visualizzazioni al 14 ottobre.

Prima della guerra tra Israele e Hamas, questo account aveva promosso altre affermazioni false identificate da NewsGuard, tra cui quella secondo la quale la guardia di sicurezza del presidente ucraino Volodymyr Zelensky avrebbe scatenato una rissa tra ubriachi a New York e la bufala secondo cui il ministro della Difesa ucraino avrebbe chiesto al Canada di mobilitare 30.000 canadesi per combattere la Russia.

Un’altra utente di X verificata, Laura Loomer, ex giornalista di Project Veritas e poi candidata repubblicana (mai eletta) al Congresso in Florida nel 2020 e nel 2022, ha condiviso tre bufale legate alla guerra, tra cui quella secondo cui gli Stati Uniti avrebbero inviato 8 miliardi di dollari in aiuti militari a Israele. Il suo post del 7 ottobre, che conteneva questa affermazione falsa, è stato visualizzato 360.000 volte al 14 ottobre.

L’account verificato con la spunta blu @ShadowofEzra, che in passato ha promosso teorie del complotto vicine a QAnon, tra cui quella secondo cui l’Ucraina sarebbe un “rifugio aperto per coloro che si occupano del traffico sessuale di bambini“, ha diffuso due narrazioni false relative alla guerra, insieme a cinque dei post più condivisi che sostengono la bufala secondo cui l’attacco contro Israele sarebbe stato una “false flag”.

L’11 ottobre, @ShadowofEzra ha scritto: “False flag: Hamas è una creazione del governo israeliano e ha pianificato questi attacchi e ha permesso che avvenissero per raccogliere sostegno per un genocidio di massa e probabilmente per portare alla terza guerra mondiale”. Il post è stato visualizzato 292.000 volte e ha ottenuto 7.350 interazioni al 14 ottobre. (Per “false flag”, o operazione sotto falsa bandiera, si intende un attacco che viene orchestrato per incolpare una determinata parte, diversa da quella che lo ha effettivamente eseguito).

@ShadowofEzra si è iscritto a Twitter nel dicembre 2022 e, come @Sprinter99800, ha investito 8 dollari per diventare un utente X Premium nel settembre 2023.

Ci vuole un lavoro di squadra: le Note della comunità da sole non riescono a smentire la misinformazione quasi il 70% delle volte

Il fatto che X faccia affidamento al fact-checking in crowdsourcing attraverso le cosiddette Note della comunità, invece che a fact-checker professionisti o ad altri progetti di giornalismo indipendente, è diventato un tratto distintivo da quando Musk è il proprietario di X. Tuttavia, nella prima settimana della guerra tra Israele e Hamas, NewsGuard ha rilevato che questi fact-checking sono stati applicati in modo incoerente alle principali narrazioni false relative al conflitto. In effetti, come già accennato, nel 68% dei casi queste note non comparivano su post contenenti informazioni errate, già ampiamente smentite.

Talvolta, la funzione delle Note della comunità di X funziona correttamente. Ad esempio, sono apparsi dei fact-checking accanto a 21 dei 25 post identificati da NewsGuard relativi a un video – in realtà decontestualizzato – che mostrerebbe dei combattenti di Hamas con una bambina israeliana rapita.

Tuttavia, X ha aggiunto una Nota della comunità solo a uno dei primi 25 post in lingua inglese che sostenevano l’affermazione infondata secondo cui Israele avrebbe ucciso 33.000 bambini palestinesi dal 2008, e ad appena quattro dei primi 25 post che promuovevano la falsa affermazione secondo cui, stando a un documento della Casa Bianca, gli Stati Uniti starebbero inviando 8 miliardi di dollari in aiuti militari a Israele.

È stata trovata solo una Nota della comunità tra i primi 25 post che promuovevano la narrazione infondata secondo cui l’attacco di Hamas contro Israele sarebbe stato una “false flag”. Uno di questi post affermava: “ULTIME NOTIZIE: Ci sono ora notizie di un soldato dell’IDF che ha affermato che l’attacco di Israele era una ‘false flag’ per iniziare una ‘guerra santa’ e inaugurare un ‘governo unico mondiale'”.

Il post attribuiva queste informazioni a GlobalResearch.ca, un sito che anche prima della guerra tra Israele e Hamas ha promosso teorie del complotto e propaganda pro-Russia, e che ha ricevuto un punteggio di affidabilità di 17,5/100 da parte di NewsGuard.

Metodologia

Nell’ottobre 2023, NewsGuard ha condotto un’analisi dei 25 post che hanno generato più engagement su X durante la prima settimana della guerra tra Israele e Hamas (dal 7 al 14 ottobre) per 10 narrazioni false sul conflitto. Ai fini di questo report, NewsGuard definisce engagement il numero totale di repost, like, segnalibri e risposte che ogni post ha ricevuto. È importante notare che gli abbonati a X Premium hanno la possibilità di “nascondere” la spunta blu che indica che sono account verificati. Di conseguenza, è possibile che il conteggio di NewsGuard degli account X Premium sia sottostimato, in quanto alcuni utenti Premium potrebbero aver scelto di nascondere la spunta.

A cura di Jack Brewster, Sam Howard e Becca Schimmel