Nel dicembre del 2020 una sorridente Regina Elisabetta faceva la sua comparsa su Channel 4 esibendosi in un balletto di Tik Tok. Contemporaneamente, sul primo canale della BBC, un’altra Elisabetta recitava il tradizionale saluto natalizio in diretta televisiva. Non fosse stato per l’assurda messinscena danzante, uno spettatore non avrebbe avuto nessun elemento per distinguere la Regina vera dal suo clone digitale. Il deepfake è una tecnologia sempre più utilizzata per costruire video fittizi, e per questo potente strumento di disinformazione digitale.

Sui pericoli del deepfake, della manipolazione audio visiva e dei synthetic media (qualsiasi video, cioè, alterato attraverso algoritimi) si concentra Soft Evidence, il progetto di due artiste americane, Ania Catherine e Dejha Ti, vincitore della categoria Artist for Media Tracks di MediaFutures, un programma di supporto europeo all’innovazione che nel 2021 ha tenuto la sua prima edizione sul rapporto con la disinformazione. Sostenuto da Horizon 2020, fondo europeo che finanzia l’innovazione e la ricerca scientifica, MediaFutures nasce per offrire supporto a startup e artisti che attraverso l’uso dei data contribuiscono allo sviluppo di un’educazione digitale.

Il progetto

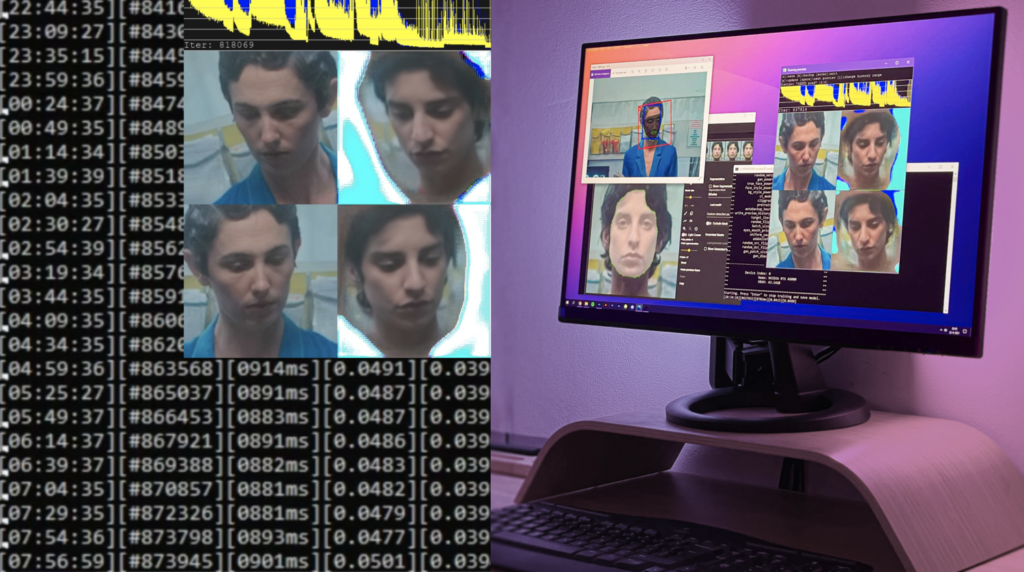

Soft Evidence si compone di 10 scene costruite attraverso l’uso dell’intelligenza artificiale: gli algoritmi dei computer sono utilizzati per realizzare brevi film che, pur sembrando reali, rappresentano qualcosa che non è mai accaduto. Per costruire le diverse scene, le artiste hanno deciso di creare un proprio set di data: per cinque giorni, in Messico, hanno fotografato e filmato loro stesse, altre persone e diversi ambienti, che attraverso un algoritmo sono stati poi inventati dalla macchina.

Inoltre, l’istallazione prevede un contratto fittizio (Synthetic and Manipulated Media Contract), firmato dalle artiste, che approvano così l’utilizzo del face swapping e di altre tecniche di manipolazione visuale. L’intento delle performer è dimostrare che i dati, anche se di libero accesso, non sono scissi dai loro corpi umani e dalle più ampie questioni di giustizia sociale: condivisi, volontariamente o no, online, sono delle potenziali armi.

Il deepfake consiste nell’alterazione del volto e del corpo di un personaggio reale: impiegato per modificare i volti di politici e celebrità, l’uso più oscuro di questa tecnica è tuttavia legato alla pornografia non consensuale, in cui dati di libero accesso vengono modificati per rappresentare donne in atti sessualmente espliciti. Ribaltando le potenzialità del deepfake in scene di vita tradizionale (seppur interamente create da un algoritmo) e utilizzando lo scambio di volti in una scena di amore tra due donne, le artiste trasportano la manipolazione digitale in un contesto apolitico, per costruire un terreno di riflessione e confronto neutrale in cui immergere lo spettatore.

L’arte di Catherine e Ti punta infatti a sconvolgere lo stato emotivo e psicologico di colui che ne fruisce. Sentimento, non spettacolo: la sintesi della loro presentazione su Operator, la casa digitale che hanno creato per condividere le loro opere. Attraverso stati emotivi e percezioni sensoriali, Soft Evidence fornisce allo spettatore strumenti e strategie per prendere coscienza sui pericoli mondo digitale. L’istallazione prevede anche un’esperienza immersiva, in cui il pubblico si confronta con esperti di deepfake, mentre i video alterati digitalmente, immagini e messaggi vocali, sono diffusi tramite Telegram in una chat creata appositamente per il progetto. La circolazione attraverso una piattaforma digitale denuncia la facilità con cui le immagini false sfuggono al nostro controllo e alla nostra capacità di riconoscerne la veridicità.

L’una coreografa e l’altra artista digitale, Catherine e Ti affrontano la relazione tra uomo e computer in tutte le loro opere. Attraverso Soft Evidence, le artiste vogliono contribuire a sviluppare una riflessione sulle visual evidence, un campo, come si legge sul sito del progetto, «sempre più complicato che dimostra che le comunità ai margini della società, più lontane dai centri di potere finanziario, tecnologico e politico, sono rese sempre più vulnerabili».

Articolo di Alissa Balocco, studentessa del Master in Giornalismo e Comunicazione Multimediale dell’Università Luiss Guido Carli.